GPT3 se autorskĂ˝m prĂĄvem nezatÄĹžuje, nemusĂ

ĂvodnĂ poznĂĄmka: Tento komentĂĄĹ berte spĂĹĄ jako menĹĄĂ Ăşvahu na tĂŠma, kde jsou hranice plagiovĂĄnĂ a zda novĂŠ druhy prediktivnĂch jazykovĂ˝ch modelĹŻ (ChatGPT apod.) nejsou vlastnÄ jen modernĂmi formami vykrĂĄdĂĄnĂ cizĂch lidskĂ˝ch myĹĄlenek, kterĂŠ jsou pak vydĂĄvĂĄny za unikĂĄtnĂ obsah. Nejde o ŞådnĂ˝ kvalifikovanĂ˝ prĂĄvnĂ vĂ˝klad, ale prostĂŠ zamyĹĄlenĂ - vĂce etickĂŠ neĹž prĂĄvnĂ. Berte tak celĂŠ sdÄlenĂ s nadhledem.

JazykovĂ˝ model GPT3 s sebou jednoznaÄnÄ pĹinesl revoluci v oblasti tvorby textĹŻ vĹĄeho druhu a jde o skvÄlĂ˝ a jistÄ velmi uĹžiteÄnĂ˝ nĂĄstroj, kterĂ˝ mĂĄ ĹĄirokou paletu uplatnÄnĂ. ZĂĄroveĹ vĹĄak s sebou nese nÄkterĂŠ ne zcela vyjasnÄnĂŠ otĂĄzky, ke kterĂ˝m patĹĂ napĹ. otĂĄzka pĹŻvodnosti, originĂĄlnosti, Äi chcete-li tzv. plagiovĂĄnĂ. A prĂĄvÄ o tom bude mĹŻj dneĹĄnĂ komentĂĄĹ.

Hned na Ăşvod - v tomto textu neĹeĹĄĂm plagiovĂĄnĂ, ve kterĂ˝m si nÄkdo pomocĂ AI vygeneruje text, kterĂ˝ pak vydĂĄvĂĄ za svĹŻj. ĹeĹĄĂm situaci, kdy AI pracuje s cizĂmi texty a cizĂmi myĹĄlenkami, kterĂŠ necituje. NeĹeĹĄĂm tedy zneuĹžitĂ AI, ale podstatu jejĂho fungovĂĄnĂ.

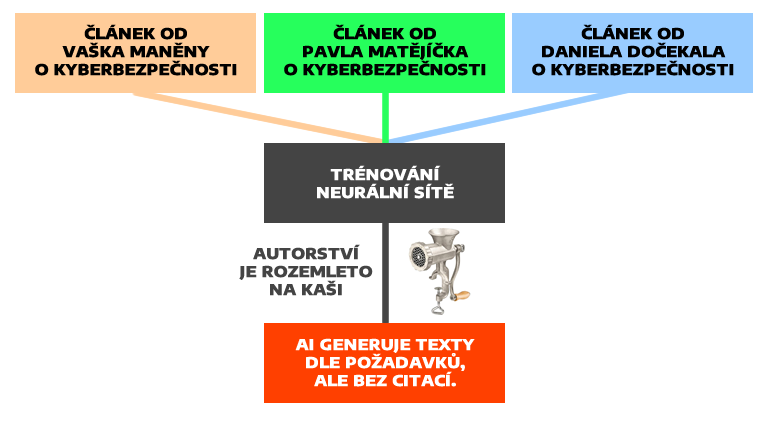

NeurĂĄlnĂ sĂtÄ a prediktivnĂ jazykovĂŠ modely se uÄĂ z velkĂŠho mnoĹžstvĂ informacĂ, kterĂŠ se snaŞà zpracovĂĄvat, tĹĂdit, vyhodnocovat, systematizovat, uspoĹĂĄdavat do logickĂ˝ch celkĹŻ, vzĂĄjemnÄ kombinovat podle rĹŻznĂ˝ch parametrĹŻ a pĹedevĹĄĂm pĹedpovĂdat, jakĂŠ informace po nÄm budeme jako lidĂŠ chtĂt, co nĂĄm mĂĄ zobrazit. ZĂĄkladem fungovĂĄnĂ je pak pĹedevĹĄĂm trĂŠnovĂĄnĂ (uÄĂ se pod dozorem Äi bez dozoru ÄlovÄka rozpoznĂĄvat konkrĂŠtnĂ informace) - konkrĂŠtnÄ model GPT-3 je natrĂŠnovĂĄn na obrovskĂŠm mnoĹžstvĂ textovĂ˝ch dat z rĹŻznĂ˝ch zdrojĹŻ na internetu, vÄetnÄ webovĂ˝ch strĂĄnek, knih, novinovĂ˝ch ÄlĂĄnkĹŻ, blogĹŻ, sociĂĄlnĂch mĂŠdiĂ a dalĹĄĂch.

BÄhem trĂŠnovĂĄnĂ se GPT-3 uÄĂ rozpoznĂĄvat a vyuĹžĂvat slovnĂ spojenĂ a kontext, coĹž mu umoĹžĹuje generovat kvalitnĂ texty s minimĂĄlnĂmi chybami (pravopis, gramatika), snaŞà se takĂŠ porozumÄt kontextu. PotĂŠ pouĹžĂvĂĄ svĂŠ znalosti a statistickĂŠ vztahy mezi slovy a vÄtami k vytvoĹenĂ novĂŠ textovĂŠ sekvence, kterĂĄ odpovĂdĂĄ poĹžadovanĂŠmu Ăşkolu nebo zadĂĄnĂ.

ZĂĄkladem jeho databĂĄze jsou vĹĄak texty, kterĂŠ vytvoĹili ĹživĂ autoĹi - aĹĽ uĹž ĹĄlo o spisovatele, vĂ˝zkumnĂky, politiky nebo tĹeba bÄĹžnĂŠ uĹživatele sociĂĄlnĂch sĂtĂ. NezapomeĹme napĹĂklad, Ĺže i Wikipedie mĂĄ svĂŠ autory a mnoho textĹŻ na Wikipedii, kterĂĄ je do trĂŠninkovĂŠ databĂĄze zahrnuta, je napĹĂklad ozdrojovĂĄno a mĂĄ svĂŠ konkrĂŠtnĂ ĹživĂŠ lidskĂŠ autory.

ProblĂŠm je, Ĺže pĹŻvod informacĂ GPT3 bÄĹžnĂ˝m uĹživatelĹŻm vĹždy neodhaluje, bÄĹžnĂ uĹživatelĂŠ dostanou finĂĄlnĂ textovĂ˝ vĂ˝stup, kterĂ˝ neobsahuje ŞådnĂŠ druhy citacĂ, odkazĹŻ, zdrojĹŻ, nevĂ tedy, z Äeho model vychĂĄzĂ, kdo je pĹŻvodce informacĂ, kterĂŠ jsou uĹživatelĹŻm prezentovĂĄny. Sama neuronovĂĄ sĂĹĽ uvĂĄdĂ, Ĺže je to dĂĄno tĂm, Ĺže je pĹĂliĹĄ sloĹžitĂĄ na to, aby uvedla vĹĄechny zdroje, ze kterĂ˝ch pĹi ĹeĹĄenĂ poĹžadavku vychĂĄzĂ, a Ĺže je obtĂĹžnĂŠ urÄit, kterĂŠ konkrĂŠtnĂ zdroje ovlivnily vĂ˝sledek. JenĹže z pohledu autorskĂŠho prĂĄva vyuĹžĂvĂĄ informace, kterĂŠ vytvoĹil nÄkdo jinĂ˝, kterĂŠ potom upravuje (i kdyĹž sofistikovanÄ) a prezentuje jako svĂŠ vlastnĂ.

SamotnĂĄ AI tvrdĂ, Ĺže nemĹŻĹže bĂ˝t obvinÄna z plagiĂĄtorstvĂ v tradiÄnĂm slova smyslu, protoĹže plagiĂĄtorstvĂ se tĂ˝kĂĄ zĂĄmÄrnĂŠho kopĂrovĂĄnĂ nebo pouĹžĂvĂĄnĂ cizĂho dĂla jako svĂŠho vlastnĂho, bez uvedenĂ zdroje. Podle svĂ˝ch slov spĂĹĄe âkombinuje a zpracovĂĄvĂĄ informace ze ĹĄirokĂŠ ĹĄkĂĄly zdrojĹŻâ. ZĂĄroveĹ vĹĄak tvrdĂ, Ĺže âPokud AI vytvĂĄĹĂ textovĂŠ dokumenty, mÄla by bĂ˝t uvĂĄdÄna citace, pokud jsou pouĹžĂvĂĄny informace z jinĂ˝ch zdrojĹŻ, stejnÄ jako u lidskĂ˝ch autorĹŻ.â

JenĹže fakticky toto vĹždy nedÄlĂĄ - respektivÄ nÄkdy zdroj uvede, jindy ne. NemluvÄ o tom, Ĺže si dokonce i vymýťlĂ fiktivnĂ zdroje informacĂ s fiktivnĂmi autory, fiktivnĂmi nĂĄzvy a fiktivnĂmi odkazy.

NavĂc i kdyĹž vyuĹžĂvĂĄme a kombinujeme ĹĄirokou ĹĄkĂĄlu zdrojĹŻ, poĹĂĄd pracujeme s dĂlem nÄkoho jinĂŠho, kterĂŠ pak buÄ citujeme pĹĂmou citacĂ, nebo jej parafrĂĄzujeme. A pozor - parafrĂĄze je interpretace cizĂch MYĹ LENEK vlastnĂmi slovy, coĹž GPT3 dÄlĂĄ - vlastnĂmi slovy vyjadĹuje cizĂ myĹĄlenky - a i zde platĂ dĹŻslednÄ pravidlo citovĂĄnĂ.

KaĹždopĂĄdnÄ AI nenĂ ÄlovÄk, nenese tedy odpovÄdnost, ta jde samozĹejmÄ za jejĂmi tvĹŻrci Äi uĹživateli (dĂĄle v textu).

PojÄme se na chvilku podĂvat na to, jak se GPT3 dĂvĂĄ na citovĂĄnĂ zdrojĹŻ, kterĂĄ vyuĹžĂvĂĄ pĹi trĂŠnovĂĄnĂ, a jak se dĂvĂĄ na citace zdrojĹŻ v rĂĄmci jiĹž vygenerovanĂ˝ch vĂ˝stupĹŻ.

JakĂ˝ je pohled GPT3 na citovĂĄnĂ zdrojĹŻ pouĹžitĂ˝ch pĹi trĂŠnovĂĄnĂ?

Výklad GPT3 s ohledem na citovånà vypadå takto:

Dotaz: MĂĄ tedy AI povinnost citovat data z webovĂ˝ch strĂĄnek, kterĂŠ pouĹžila pĹi uÄenĂ?

GPT3: Ne, obecnÄ AI nenĂ povinna citovat data, kterĂĄ byla pouĹžita pĹi jejĂm uÄenĂ. To je z toho dĹŻvodu, Ĺže umÄlĂĄ inteligence nenĂ subjektem, kterĂ˝ by mÄl bĂ˝t odpovÄdnĂ˝ za citaci zdrojĹŻ. NamĂsto toho je zodpovÄdnostĂ lidĂ, kteĹĂ vytvoĹili a nasadili AI do provozu, aby se ujistili, Ĺže pouĹžĂvajĂ data a zdroje sprĂĄvnĂ˝m zpĹŻsobem a v souladu se zĂĄkony a pravidly.

To znamenĂĄ, Ĺže pokud byly textovĂĄ data pouĹžita k trĂŠnovĂĄnĂ AI zĂskĂĄna z veĹejnÄ dostupnĂ˝ch zdrojĹŻ, jako jsou webovĂŠ strĂĄnky, knihy, noviny a dalĹĄĂ, nenĂ nutnĂŠ citovat kaĹždĂ˝ zdroj. NicmĂŠnÄ, pokud byly pouĹžity citlivĂŠ informace nebo data, kterĂĄ byla chrĂĄnÄna autorskĂ˝mi prĂĄvy, mĹŻĹže bĂ˝t potĹeba zĂskat souhlas autora nebo vlastnĂka prĂĄv na citaci zdroje.

SkuteÄnÄ nechci nijak tvrzenĂ GPT3 prĂĄvnÄ rozporovat, ale kaĹždĂŠ originĂĄlnĂ dĂlo je chrĂĄnÄno autorskĂ˝m zĂĄkonem, vÄetnÄ veĹejnÄ dostupnĂ˝ch knih, webĹŻ, novin apod. MaximĂĄlnÄ za jeho uĹžitĂ autoĹi nevybĂrajĂ finance, ale je vĹždy spojeno s nimi samotnĂ˝mi, s jejich jmĂŠnem, s jejich osobou Äi institucĂ. Nikdo je jejich autorstvĂ a prĂĄv automaticky nemĹŻĹže zbavit. GPT3 ale jejich autorstvĂ trĂŠnovĂĄnĂm ârozpouĹĄtĂâ. UrÄitÄ nĂŠ vĹždy, ale velmi Äasto ano.

Je to srovnatelnĂŠ se situacĂ, kdy studentovi zadĂĄme vytvoĹit esej na nÄjakĂŠ konkrĂŠtnĂ tĂŠma. Student nejdĹĂve nastuduje zdroje, knihy, encyklopedie, webovĂŠ strĂĄnky, potĂŠ si promyslĂ, o Äem a jak bude psĂĄt, a zaÄne tvoĹit text. V pĹĂpadÄ konkrĂŠtnĂch myĹĄlenek, definic, informacĂ vĹĄak vĹždy dĹŻslednÄ cituje zdroje, nekrade cizĂ myĹĄlenky! AI to vĹĄak dÄlĂĄ a vymlouvĂĄ se na to, Ĺže protoĹže nenĂ ÄlovÄk a protoĹže zdrojĹŻ prostudovala fakt hodnÄ, nemĹŻĹže ani ty nejrelevantnÄjĹĄĂ zdroje uvĂŠst.

StudentĹŻ se u zkouĹĄek pravidelnÄ ptĂĄme, z Äeho jste se uÄili (âtrĂŠnovaliâ), a studenti nĂĄm samozĹejmÄ (aspoĹ nÄjakĂŠ) zdroje uvedou. V pĹĂpadÄ AI by ovĹĄem toto neplatilo.

JakĂ˝ je pohled GPT3 na citovĂĄnĂ zdrojĹŻ pouĹžitĂ˝ch pĹi generovĂĄnĂ vĂ˝sledku?

Jedna vÄc je citace zdrojĹŻ pĹi trĂŠnovĂĄnĂ, druhĂĄ vÄc je citace zdrojĹŻ pĹi generovĂĄnĂ vĂ˝sledkĹŻ. JakĂ˝ je pohled GPT3?

GTP3: Data, kterĂĄ jsou generovĂĄna AI, jsou vytvĂĄĹena na zĂĄkladÄ trĂŠnovĂĄnĂ modelu na vstupnĂch datech. Tyto vstupnĂ data mohou pochĂĄzet z rĹŻznĂ˝ch zdrojĹŻ, jako jsou webovĂŠ strĂĄnky, knihy, noviny a dalĹĄĂ, a takĂŠ z dat, kterĂĄ byla vytvoĹena firmou OpenAI pro ĂşÄely trĂŠnovĂĄnĂ modelu.

Data, kterĂĄ jsou generovĂĄna AI, nejsou pĹesnÄ definovĂĄna jako autorskĂĄ dĂla v tradiÄnĂm slova smyslu, protoĹže byla vytvoĹena strojem a nikoliv ÄlovÄkem. NicmĂŠnÄ, pokud jsou generovanĂĄ data chrĂĄnÄna prĂĄvy duĹĄevnĂho vlastnictvĂ, napĹĂklad patentovĂ˝mi prĂĄvy, mĹŻĹže bĂ˝t potĹeba zĂskat souhlas vlastnĂka prĂĄv k pouĹžitĂ tÄchto dat.

ObecnÄ se AI nepovaĹžuje za subjekt, kterĂ˝ by byl povinen citovat zdroje, protoĹže AI nenĂ subjektem, kterĂ˝ by mÄl bĂ˝t odpovÄdnĂ˝ za citaci zdrojĹŻ. Na druhĂŠ stranÄ, vlastnĂci a tvĹŻrci AI by mÄli dodrĹžovat platnĂŠ zĂĄkony a pravidla tĂ˝kajĂcĂ se prĂĄv duĹĄevnĂho vlastnictvĂ a zajistit, aby jejich pouĹžitĂ dat bylo v souladu s tÄmito zĂĄkony a pravidly.

TakĹže si to pojÄme shrnout - AI ĹĂkĂĄ, Ĺže je sice natrĂŠnovĂĄna na lidskĂ˝ch datech, ale Ĺže vĂ˝sledky vlastnÄ nejsou âtradiÄnĂmi autorskĂ˝mi dĂlyâ, protoĹže je vygeneroval stroj, takĹže citovat nemusĂ, protoĹže za citace jsou odpovÄdnĂ lidĂŠ, ne stroje. Je to pomÄrnÄ jasnĂĄ ukĂĄzka poruĹĄenĂ zĂĄkladnĂch etickĂ˝ch principĹŻ k duĹĄevnĂmu vlastnictvĂ.

âMaĹžeâ trĂŠnovĂĄnĂ AI autorskĂĄ prĂĄva?

To, co GPT3 opakovanÄ uvĂĄdĂ, mÄ vede k zĂĄvÄru, Ĺže v prĹŻbÄhu trĂŠnovĂĄnĂ prostÄ umÄlĂĄ inteligence autorstvĂ lidĂ maĹže. Tj. jakmile se jednou stane konkrĂŠtnĂ autorskĂ˝m prĂĄvem chrĂĄnÄnĂ˝ materiĂĄl souÄĂĄstĂ trĂŠnovĂĄnĂ a jeho myĹĄlenky jsou pĹedĂĄny do neurĂĄlnĂ sĂtÄ, autorskĂŠ prĂĄvo je rozemleto na padrĹĽ. KdyĹž se vĹĄak podĂvĂĄme na vĂ˝stupy, kterĂŠ jsou AI generovĂĄny, jasnÄ vykazujĂ shodu s celou Ĺadou pĹŻvodnĂch zdrojĹŻ. Viz tĹeba tento pĹĂpad:

Toto je definice sextingu podle AI:

Sexting je termĂn, kterĂ˝ popisuje posĂlĂĄnĂ sexuĂĄlnÄ explicitnĂch zprĂĄv, fotografiĂ nebo videĂ mezi lidmi pomocĂ mobilnĂch telefonĹŻ nebo jinĂ˝ch elektronickĂ˝ch zaĹĂzenĂ. Tyto zprĂĄvy mohou bĂ˝t posĂlĂĄny mezi partnery v intimnĂch vztazĂch, ale mohou bĂ˝t takĂŠ zasĂlĂĄny mezi lidmi, kteĹĂ se teprve poznĂĄvajĂ.

A pro srovnĂĄnĂ definice sextingu dle Wikipedie se zdrojovĂĄnĂm konkrĂŠtnĂch textĹŻ:

Sexting je posĂlĂĄnĂ, pĹijĂmĂĄnĂ nebo pĹeposĂlĂĄnĂ sexuĂĄlnÄ explicitnĂch zprĂĄv, fotografiĂ nebo videĂ, pĹedevĹĄĂm mezi mobilnĂmi telefony. MĹŻĹže zahrnovat takĂŠ pouĹžitĂ poÄĂtaÄe nebo jinĂŠho digitĂĄlnĂho zaĹĂzenĂ.[1] Tyto materiĂĄly Äasto vznikajĂ v rĂĄmci partnerskĂ˝ch vztahĹŻ.

MĂra shoda je na prvnĂ pohled zĹejmĂĄ, pĹesto nenĂ zdroj ocitovĂĄn vĹŻbec.

NÄkde v procesu prĂĄce s informacemi jednoduĹĄe dochĂĄzĂ k âzĂĄniku autorstvĂâ a data, kterĂĄ vychĂĄzĂ z umÄlĂŠ inteligence ven, se tvĂĄĹĂ jako unikĂĄtnĂ, protoĹže byla unikĂĄtnÄ nakombinovĂĄna (tj. sestavena AI). PoĹĂĄd ale vĂ˝stup vyjadĹuje ĂşplnÄ stejnĂŠ myĹĄlenky, kterĂŠ pochĂĄzejĂ od konkrĂŠtnĂch autorĹŻ a osob, jenom se liĹĄĂ formou (a procesem tvorby). V tom vidĂm jednu zĂĄkladnĂ odliĹĄnost oproti napĹ. klasickĂŠmu personalizovĂĄnĂŠmu vyhledĂĄvĂĄnĂ na Google - Google vĹždy nabĂdne konkrĂŠtnĂ odkaz na konkrĂŠtnĂ zdroj, autorstvĂ nemizĂ! A my si jej mĹŻĹžeme ovÄĹit!

KomerÄnĂ dopady? UrÄitÄ ano!

Tento zpĹŻsob fungovĂĄnĂ AI mĹŻĹže autorĹŻm rĹŻznĂ˝ch typĹŻ veĹejnĂ˝ch textĹŻ pĹinĂŠst mnoho nepĹĂjemnostĂ - aĹĽ jiĹž jde o snĂĹženĂ nĂĄvĹĄtÄvnosti jejich webĹŻ, tj. snĂĹženĂ ziskĹŻ z reklamy, snĂĹženĂ poÄtu klientĹŻ, kteĹĂ se o nabĂdce sluĹžeb danĂŠ osoby obtĂĹžnÄji dozvĂ, naopak AI bude ve svĂŠ placenĂŠ verzi profitovat prĂĄvÄ z toho, Ĺže bude nekontrolovanÄ vytÄĹžovat cizĂ zdroje a cizĂ prĂĄci, ze kterĂŠ autoĹi nebudou nic mĂt. NabĂzĂ se paralela s nedĂĄvnou novelou autorskĂŠho zĂĄkona, po kterĂŠ Google odstranil nĂĄhledy zpravodajskĂŠho obsahu ze svĂŠho vyhledĂĄvaÄe, a to prosĂm nikdo nepĹichĂĄzel o autorstvĂ (maximĂĄlnÄ o zisky, ale o autorstvĂ ne).

ĹeĹĄenĂ - uvĂĄdÄt alespoĹ zĂĄkladnĂ zdroje

IdeĂĄlnĂm ĹeĹĄenĂm by bylo, aby jazykovĂŠ modely uvĂĄdÄly odkazy alespoĹ na zĂĄkladnĂ relevatnĂ zdroje, ze kterĂ˝ch vygenerovanĂ˝ text vychĂĄzĂ (Äi na kterĂ˝ch byl natrĂŠnovĂĄn). Takto funguje napĹ. AI integrovanĂĄ do Bingu (Microsoft) - k vygenerovanĂŠmu textu dodĂĄvĂĄ i relevantnĂ Äi doporuÄenĂŠ zdroje. TĂm pĂĄdem lze ovÄĹit a ocitovat zcela konkrĂŠtnĂ zdroj informace.

Kdo nese odpovÄdnost za dodrĹžovĂĄnĂ autorskĂŠho prĂĄva umÄlou inteligencĂ?

NabĂzĂ se otĂĄzka, kdo nese odpovÄdnost za to, kdyĹž bude umÄlĂĄ inteligence poruĹĄovat autorskĂĄ prĂĄvo. Hned na Ăşvod je potĹeba ĹĂci, Ĺže umÄlĂĄ inteligence je pouhĂ˝m nĂĄstrojem v rukou ÄlovÄka, nemĹŻĹže nabĂ˝vat prĂĄva, zavazovat se k povinnostem ani odpovĂdat za svĂŠ jednĂĄnĂ. KdyĹž tedy umÄlĂĄ inteligence poruĹĄĂ autorskĂŠ prĂĄvo, tĹeba vytvoĹĂ plagiĂĄt, bude za ni odpovĂdat ÄlovÄk. (zdroj) A to buÄ jejĂ autor (ÄlovÄk, firma, organizace, kterĂĄ dopustila, Ĺže AI poruĹĄuje autorskĂĄ prĂĄva), nebo ÄlovÄk, kterĂ˝ vygenerovanĂ˝ vĂ˝stup zneuĹžije. Pokud tedy tvĹŻrce umÄlĂŠ inteligence dopustĂ, Ĺže ta bude vyuĹžĂvat obsah textu nÄkoho jinĂŠho v rozporu s autorskĂ˝m prĂĄvem, nese odpovÄdnost.

KaĹždopĂĄdnÄ GPT3 jednoznaÄnÄ pĹedstavuje prĂĄvnĂ vĂ˝zvu a bude nutnĂŠ skuteÄnÄ vyjasnit, jak to s tÄmi citacemi a zdroji je a co se dÄje s autorstvĂm lidĂ, jejichĹž data byla vyuĹžita.

Pokud se vĂĄm text lĂbil, mĹŻĹžete mi koupit kafe. :-)

P. S. ObrĂĄzky vygenerovĂĄny tradiÄnÄ v Midjourney pod komerÄnĂ licencĂ.

ZobrazenĂ: 3976NejÄtenÄjĹĄĂ za poslednĂ rok

- MoĹžnosti vyuĹžitĂ generativnĂ umÄlĂŠ inteligence ve vĂ˝uce ÄeskĂŠho jazyka a literatury se zamÄĹenĂm na aktivitu ŞåkĹŻ (nÄkolik nĂĄmÄtĹŻ)

- UmÄlĂŠ inteligenci dÄkujte, i kdyĹž to stojĂ prachy

- Je na Äase zruĹĄit anonymitu sociĂĄlnĂch sĂtĂ, pĹispĂvĂĄ razantnĂmu nĂĄrĹŻstu nĂĄsilĂ ve spoleÄnosti

- UÄitelstvĂ nenĂ poslĂĄnĂ. Je to profese!

- ZkuĹĄenosti se ĹĄpanÄlskĂ˝m blackoutem pohledem turisty z ÄR

NejÄtenÄjĹĄĂ (90 dnĂ)

- Rady pro uÄitele, kteĹĂ neumĂ uÄit (a chtÄli by to zmÄnit)

- Rychlost mĂsto pĹemýťlenĂ? Jak mÄ umÄlĂĄ inteligence uÄĂ bĂ˝t lĂnÄjĹĄĂ

- PostesknutĂ

- Svoboda slova v kĹeÄi: Mezi stĂĄtnĂ cenzurou, byznysem s lŞà a mlÄenĂm elit

- VR headsety: PĂĄr tipĹŻ na aplikace, kterĂŠ vĂĄm zaruÄenÄ zlepĹĄĂ fyziÄku (dĂl 1)